En la era de los datos, la inteligencia artificial y el machine learning se están convirtiendo rápidamente en las tecnologías más importantes para las empresas. Sin embargo, implementar con éxito un modelo de machine learning no es tarea fácil. Es por eso que MLOps (Machine Learning Operations) se ha vuelto esencial para gestionar todo el ciclo de vida de un modelo de machine learning, desde la creación y el entrenamiento hasta la implementación y la monitorización.

En este artículo, exploraremos qué es MLOps y cómo implementar modelos de machine learning con éxito utilizando esta práctica cada vez más popular.

Contenidos

¿Qué es MLOps y por qué es importante?

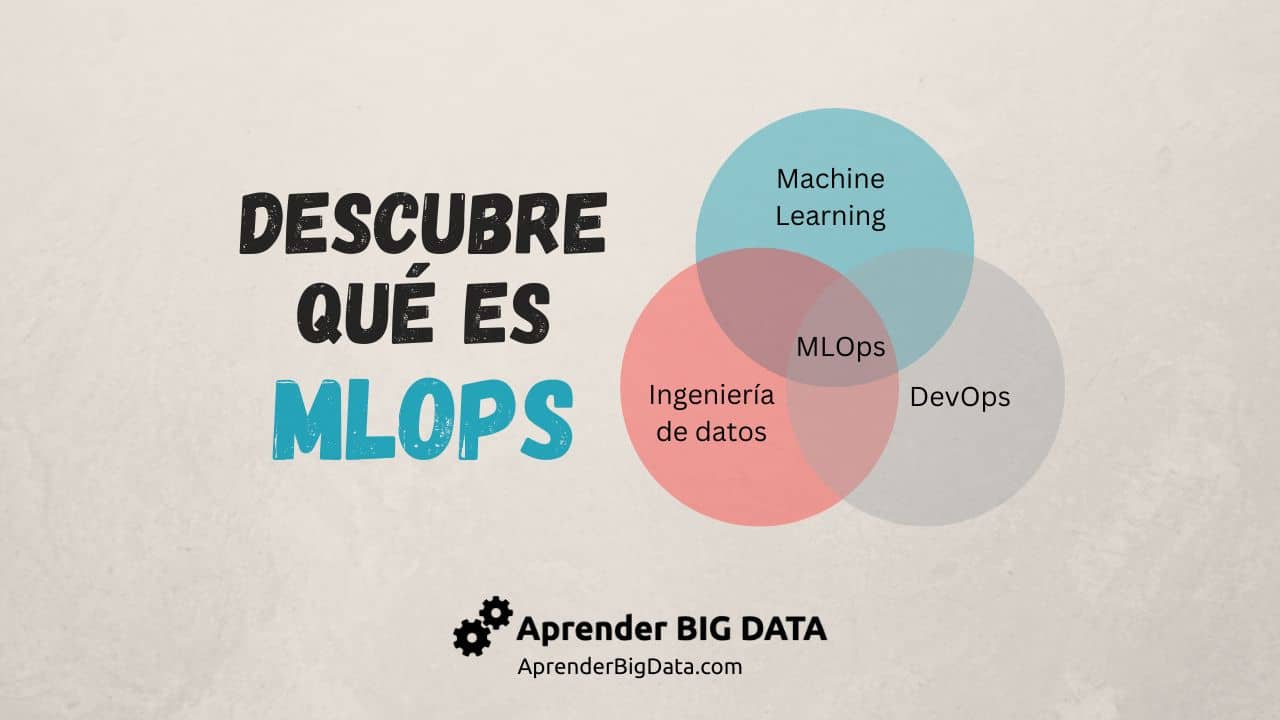

MLOps es una metodología que combina prácticas de desarrollo de software y de operaciones para la implementación de modelos de machine learning (ML) en entornos de producción. Esta metodología se enfoca en automatizar y estandarizar todo el ciclo de vida de los modelos, desde su desarrollo hasta su despliegue y su monitorización en producción.

MLOps se ha vuelto importante porque permite a las empresas escalar sus modelos de machine learning de manera efectiva y asegurar su calidad y estabilidad en producción. Al automatizar los procesos de implementación, las empresas pueden reducir los errores humanos, mejorar la reproducibilidad y mantener una mayor consistencia en los modelos.

Además, MLOps también ayuda a acelerar la implementación de los modelos, lo que puede ser fundamental para competir en el mercado actual.

Etapas clave en el ciclo de vida de un modelo de machine learning

El ciclo de vida de un modelo de machine learning consta de varias etapas que incluyen desde la recopilación y preparación de los datos, hasta la implementación y mantenimiento del modelo en producción.

A continuación, veremos en detalle cada una de las etapas clave del ciclo de vida de un modelo de machine learning.

- Recopilación de datos: La primera etapa es la recopilación de los datos necesarios para entrenar el modelo. Es importante recopilar una cantidad suficiente de datos relevantes para que el modelo pueda aprender patrones y hacer predicciones precisas.

- Preparación de datos: Una vez que se han recopilado los datos, es necesario prepararlos para su uso en el entrenamiento del modelo. Esto puede incluir la limpieza de datos, la eliminación de valores atípicos, la normalización y la transformación de los datos.

- Selección y entrenamiento de modelos: La siguiente etapa es la selección y entrenamiento de modelos de machine learning. Se pueden utilizar varios tipos de modelos, como redes neuronales, árboles de decisión, regresión lineal, entre otros. Es importante evaluar varios modelos y seleccionar el que tenga el mejor rendimiento y ofrezca los mejores resultados.

- Evaluación y ajuste de modelos: Una vez que se han entrenado varios modelos, es necesario evaluar su rendimiento y ajustarlos para mejorar su precisión y evitar el sobreajuste (overfitting).

- Implementación en producción: Después de seleccionar el modelo final y ajustar su rendimiento, es necesario implementarlo en producción. Esto implica integrar el modelo en una aplicación o sistema para que pueda hacer predicciones en tiempo real.

- Monitorización y mantenimiento: Después de implementar el modelo en producción, es importante monitorizarlo y mantenerlo. Así, es necesario realizar el seguimiento del rendimiento del modelo, la detección y corrección de errores, y la actualización del modelo a medida que se recopilan más datos.

¿Quieres Convertirte en experto en Machine Learning?

Una vez que se ha entrenado un modelo de machine learning, se necesita ponerlo en producción y asegurarse de que funcione correctamente en el mundo real. Es en este punto donde entra en juego MLOps: el conjunto de prácticas y herramientas que se utilizan para implementar, mantener y escalar modelos de machine learning de manera eficiente y efectiva.

Herramientas y tecnologías para implementar MLOps

Para implementar con éxito MLOps, es fundamental contar con las herramientas y tecnologías adecuadas que permitan gestionar y automatizar el ciclo de vida completo de los modelos de machine learning. A continuación, te presento algunas de las herramientas y tecnologías clave para implementar MLOps:

1. Gestión de Versiones

La gestión de versiones es fundamental para el desarrollo colaborativo de modelos de machine learning. Las herramientas de control de versiones como Git, permiten gestionar el código fuente de los modelos, realizar seguimiento de los cambios y revertir a versiones anteriores. Además, permiten la colaboración en equipo y el trabajo en ramas independientes.

2. Entornos Virtuales

Los entornos virtuales permiten gestionar las dependencias y configuraciones específicas de cada proyecto de machine learning. Herramientas como Conda o Pipenv para Python permiten crear entornos virtuales que contienen todas las dependencias y versiones de las bibliotecas necesarias para ejecutar el modelo de machine learning.

3. Automatización de Flujo de Trabajo

Para automatizar el flujo de trabajo de los modelos de machine learning, se pueden utilizar herramientas como Apache Airflow, que permite programar y ejecutar tareas en diferentes etapas del ciclo de vida de un modelo. Además, permite la monitorización y la gestión de errores durante la ejecución.

4. Integración Continua y Entrega Continua CI/CD

La integración continua y entrega continua (CI/CD) es una práctica común en el desarrollo de software que también se puede aplicar en el desarrollo de modelos de machine learning. Herramientas como Jenkins, GitLab CI/CD o CircleCI permiten automatizar la integración y el despliegue de los modelos de machine learning en diferentes entornos.

5. Gestión de Modelos

Para la gestión de modelos de machine learning, existen herramientas específicas como MLflow, Kubeflow o H2O.ai. Estas herramientas permiten realizar el seguimiento de los modelos, gestionar las versiones y configuraciones, realizar el registro de los resultados y métricas de los modelos, y facilitar su implementación en diferentes entornos.

Desafíos comunes al implementar MLOps

Los desafíos al implementar MLOps pueden ser variados y complejos, pero se pueden abordar con un enfoque y herramientas adecuadas. Aquí tienes algunos desafíos comunes y cómo abordarlos:

1. Gestión de versiones del modelo: La gestión de versiones de los modelos de machine learning es un desafío importante en MLOps. Necesitamos versiones precisas y rastreables de los modelos para garantizar la reproducibilidad y la transparencia de los resultados. Para abordar este desafío, se pueden utilizar herramientas de control de versiones como hemos visto en el apartado anterior.

2. Escalabilidad y rendimiento: Los modelos de machine learning a menudo se ejecutan en grandes conjuntos de datos y requieren una gran cantidad de recursos de computación. Para abordar este desafío, se pueden utilizar herramientas como Kubernetes o Apache Airflow. Estas herramientas permiten la escalabilidad y el rendimiento de los modelos de manera eficiente.

3. Monitorización y mantenimiento: Los modelos de machine learning requieren una monitorización constante para garantizar que sigan siendo precisos y confiables. Para abordar este desafío, se pueden utilizar herramientas como Grafana o Prometheus, que permiten la visualización y la monitorización de los modelos en tiempo real.

4. Gestión de datos: La gestión de datos es un desafío común en MLOps, ya que se requiere una gran cantidad de datos de alta calidad para entrenar y probar modelos de machine learning. Para abordar este desafío, se pueden utilizar herramientas de gestión de datos como Databricks que permiten la gestión y el procesamiento de grandes conjuntos de datos de manera eficiente.

5. Cultura de colaboración: MLOps requiere una cultura de colaboración entre los equipos de desarrollo, los científicos de datos y los ingenieros de machine learning. Para abordar este desafío, se pueden utilizar herramientas de colaboración como Slack o Microsoft Teams, que permiten la comunicación y la colaboración efectivas entre los equipos de manera eficiente.

Curso Recomendado de MLFlow

En mi artículo de análisis detallo los mejores programas de máster en la actualidad para estudiar inteligencia artificial. No te lo pierdas.

Curso MLflow en acción

Lo mejor de este curso de MLflow es que está orientado a la práctica, y te enseña a aplicar MLflow con ejemplos reales, incluyendo tracking, modelos, artefactos y despliegue. Parte desde cero y escala a flujos más complejos, ideal tanto si estás empezando con MLOps como si necesitas estructurar proyectos productivos.

Además, se ha adaptado a las versiones recientes de MLflow, corrigiendo bugs anteriores y añadiendo soporte para workflows modernos.

Ideal para: Ingenieros de datos y ML Engineers, científicos de datos que quieren llevar modelos a producción y equipos que buscan formalizar su flujo de ML con herramientas reales.

Preguntas Frecuentes de MLOps

¿Qué es la integración continua en el contexto de MLOps?

La integración continua se refiere a la práctica de fusionar el código de varios desarrolladores en un solo proyecto en forma continua y automática, para detectar y corregir errores de manera temprana. En el contexto de MLOps, esto se aplica a la integración de modelos de machine learning en el flujo de trabajo de desarrollo.

¿Por qué es importante tener una infraestructura escalable en MLOps?

Los modelos de machine learning suelen requerir una gran cantidad de recursos de cómputo, como CPU y GPU. Una infraestructura escalable permite ajustar la cantidad de recursos necesarios según las necesidades del modelo. Esto también permite hacer un uso más eficiente de los recursos y una mejor gestión de costes.

¿Qué papel juegan las pruebas de aceptación en MLOps?

Las pruebas de aceptación son una parte crucial del proceso de implementación de MLOps. Nos permiten validar que el modelo de machine learning funciona como se esperaba en un ambiente controlado antes de su implementación. Esto ayuda a reducir el riesgo de problemas en producción y a garantizar su calidad.

¿Cómo puede ayudar la automatización en MLOps?

La automatización puede ayudar a reducir el tiempo y los errores en el proceso de implementación de modelos de machine learning, al permitir la creación de pipelines automatizados que abarquen desde la integración de datos hasta la implementación del modelo en producción. También puede permitir una mejor gestión de recursos y un uso más eficiente del tiempo de los desarrolladores.